Представьте машинистку 1990-х: она слушает диктофонную запись и печатает текст со скоростью 200 символов в минуту. Час аудио — 4-5 часов работы. Ошибки, усталость, перерывы на кофе. Сегодня нейросеть расшифровывает тот же час за 5-10 минут с точностью до 97%. По данным Grand View Research, 62% профессионалов, использующих AI-транскрибацию, экономят больше 4 часов в неделю.

Но технология шагнула дальше простой расшифровки. Современная транскрибация нейросетью — это не только текст из аудио. Это разделение спикеров, автоматическая пунктуация, распознавание 100+ языков и — для бизнеса — фундамент для анализа звонков, контроля менеджеров и роста продаж.

В этой статье разберем, как работают нейросети для транскрибации, сравним лучшие сервисы с акцентом на русский язык и покажем, почему для бизнес-задач одной расшифровки уже недостаточно.

Важная информация: Рынок AI-транскрибации растет лавинообразно. По прогнозу Market.us, к 2034 году его объем увеличится в 4 раза — с $4,5 до $19,2 млрд. Нейросети для перевода речи в текст стали одной из самых быстрорастущих AI-технологий.

- Что такое транскрибация нейросетью и как она работает

- Архитектура трансформеров и Whisper

- Метрика WER — как измеряется точность

- Зачем нужна нейросеть для транскрибации

- Лучшие нейросети для транскрибации в 2026 году

- Whisper (OpenAI)

- SaluteSpeech (Сбер)

- Teamlogs

- BotHub

- Speechnotes

- AssemblyAI

- Сравнительная таблица

- Как выбрать нейросеть для транскрибации — 6 критериев

- Как улучшить качество транскрибации — практические советы

- Транскрибация для бизнеса — от расшифровки к аналитике

- Что делать после транскрибации — 3 уровня ценности

- Мнение эксперта

- Часто задаваемые вопросы

- Выводы

Что такое транскрибация нейросетью и как она работает

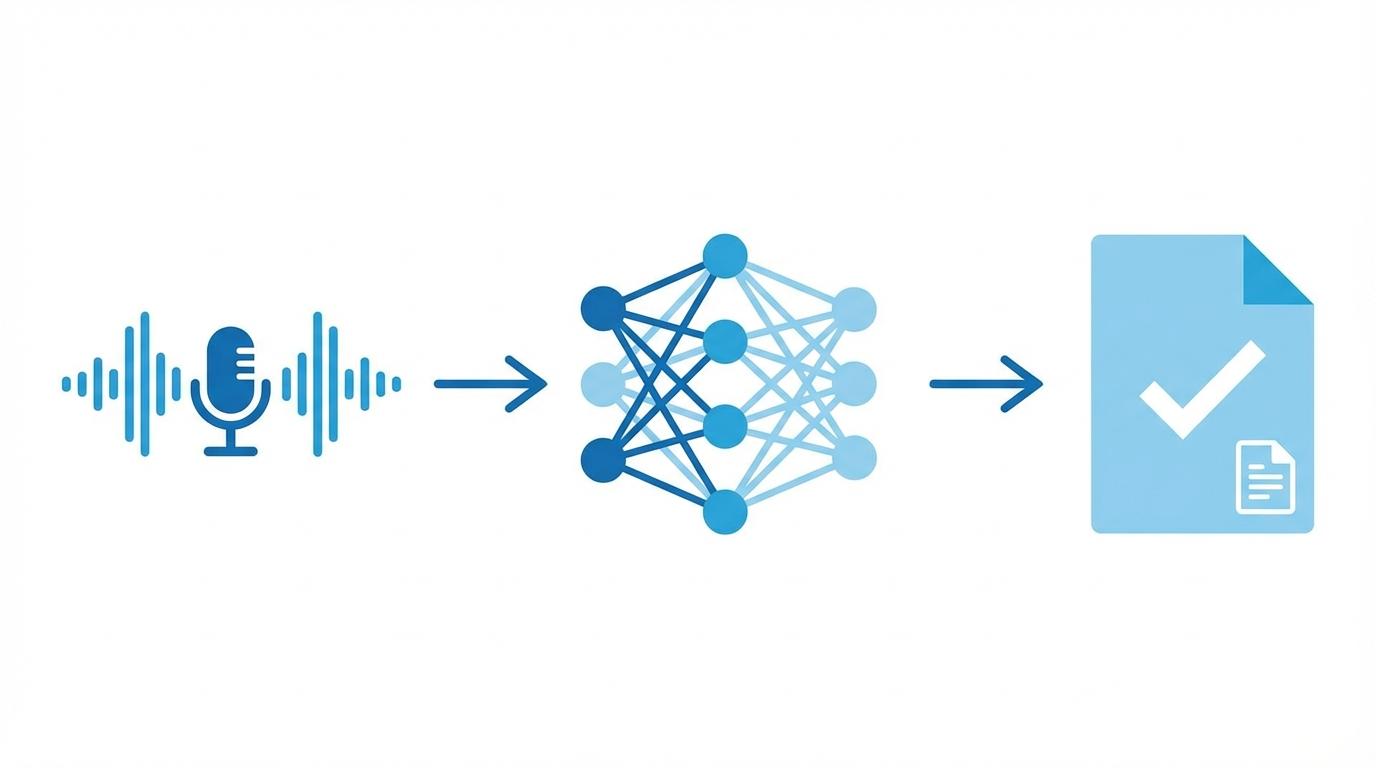

Транскрибация нейросетью (Speech-to-Text, STT) — это автоматический перевод аудиозаписи в текст с помощью нейронных сетей. Нейросеть обрабатывает звук примерно как мозг человека: разбивает аудиопоток на фрагменты, распознает паттерны и собирает из них слова и предложения.

До 2020-х годов системы распознавания речи (ASR) работали по правилам: акустическая модель + языковая модель + словарь. Результаты были посредственными, особенно на зашумленных записях. Все изменилось с появлением глубокого обучения и архитектуры трансформеров — тех же технологий, что стоят за ChatGPT.

Архитектура трансформеров и Whisper

Настоящую революцию совершил Whisper от OpenAI в 2022 году. Эта модель использует архитектуру «энкодер-декодер»: энкодер превращает звуковую волну в спектрограмму и находит в ней признаки речи, а декодер переводит эти признаки в текст. Упрощенно: энкодер «слушает», декодер «пишет».

Почему Whisper стал стандартом отрасли? Три причины. Во-первых, масштаб обучения: Whisper Large-v3 натренирован на 5 миллионах часов аудио из интернета (по данным OpenAI GitHub). Во-вторых, мультиязычность: поддержка более 100 языков, включая русский. В-третьих, открытый код: любой может запустить модель бесплатно на своем компьютере.

Whisper выпускается в нескольких версиях — от tiny (39 млн параметров, быстро, но менее точно) до large-v3 (1,55 млрд параметров, медленнее, но максимальная точность). Бонус: модель тренировалась на данных с шумом, поэтому устойчива к помехам — музыка на фоне, эхо, перекрестные разговоры.

Метрика WER — как измеряется точность

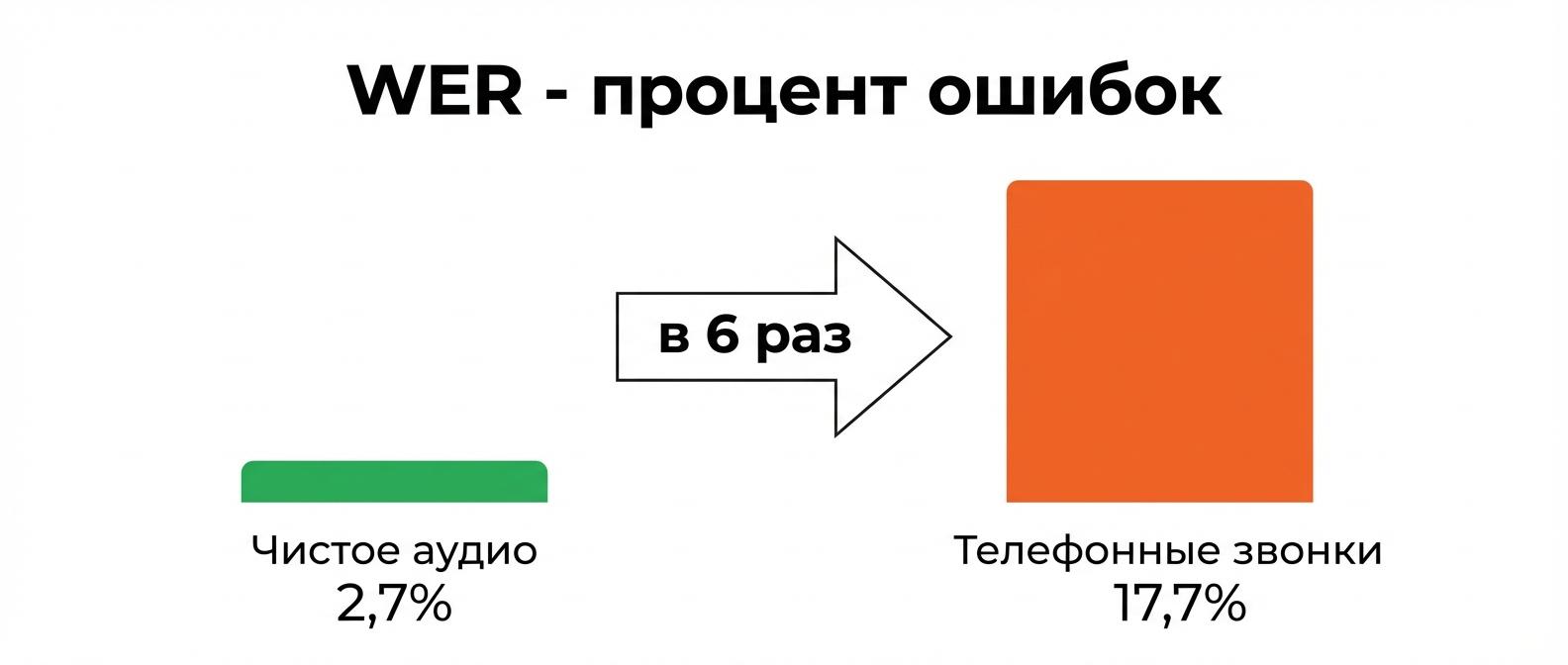

Точность транскрибации измеряется метрикой WER (Word Error Rate) — процентом ошибочно распознанных слов. Формула: WER = (вставки + удаления + замены) / общее количество слов. Чем ниже WER, тем точнее распознавание.

На чистых студийных записях лучшие модели показывают WER 2-5%. Это значит, что из 100 слов ошибка встретится в двух-пяти. Но вот ключевой момент: по данным бенчмарков AssemblyAI (2025), на телефонных звонках WER Whisper Large-v3 возрастает до 17,7%. Разница в 6 раз. Каждое шестое слово — с ошибкой.

Внимание: WER 2,7% на чистом аудио и WER 17,7% на телефонных звонках — это разные вселенные. Если вы планируете расшифровывать звонки отдела продаж, учитывайте: сжатие кодеков, шумы и плохая связь снижают точность в разы. Для бизнес-задач нужны модели, оптимизированные под телефонное аудио.

Зачем нужна нейросеть для транскрибации

Главная причина — экономика. Ручная расшифровка часового аудио стоит $1,50-4,00 за минуту и занимает 3-5 часов работы транскрибатора. Нейросеть обрабатывает тот же файл за 5-10 минут по цене $0,10-0,30 за минуту (данные Transcripter.co, 2024). Разница в 10-15 раз по стоимости и в 30-60 раз по скорости.

Вторая причина — масштабируемость. Нанять 10 транскрибаторов для расшифровки 50 файлов в день — логистический кошмар. Нейросеть обработает 50 или 5000 файлов одним пакетом. Процесс не зависит от людей, настроения, отпусков и больничных.

Конкретные задачи, которые решает нейросетевая транскрибация:

- Расшифровка интервью и подкастов для создания контента

- Протоколирование совещаний и рабочих встреч

- Создание субтитров к видео (YouTube, обучающие курсы)

- Расшифровка лекций и учебных материалов

- Анализ телефонных звонков в отделах продаж и колл-центрах

- Расшифровка судебных заседаний и медицинских консультаций

Пример: Журналист проводит часовое интервью. Ручная расшифровка: 4-5 часов работы, стоимость 5 000-10 000 рублей у фрилансера. Нейросеть: 10 минут обработки, стоимость 100-300 рублей. При 20 интервью в месяц экономия — более 80 часов и 100 000 рублей.

Лучшие нейросети для транскрибации в 2026 году

На рынке десятки сервисов, но не все одинаково хорошо работают с русским языком. Ниже — обзор шести решений, которые показали лучшие результаты на русскоязычном аудио.

Whisper (OpenAI)

Открытая модель, стандарт отрасли. Whisper Large-v3 показывает WER 2,7% на чистом аудио и поддерживает более 100 языков. Можно запустить бесплатно на локальном компьютере (нужна видеокарта с 4+ ГБ памяти) или использовать через API. Минус: нет встроенной диаризации (разделения по спикерам) — нужны дополнительные инструменты. Для локального запуска потребуются технические навыки.

SaluteSpeech (Сбер)

Российская разработка, оптимизированная под русский язык. Облачное API с серверами в России — важно для компаний с требованиями по хранению данных. Хорошо справляется с бизнес-лексикой и разговорной речью. Минус: ориентирован на корпоративных клиентов, для личного использования есть более простые альтернативы.

Teamlogs

Российский SaaS-сервис с веб-интерфейсом. Поддерживает русский язык, есть встроенный ИИ-чат для редактирования и обработки транскрипта (создание статей, выжимок, протоколов). Удобен для контент-менеджеров и журналистов. Минус: бесплатный доступ ограничен 15 минутами, для регулярной работы потребуется платная подписка.

BotHub

Агрегатор AI-моделей, использует Whisper под капотом. Мультиязычная поддержка, простой интерфейс. Доступен через веб и Telegram-бот. Минус: нужен аккаунт и кредиты для использования, бесплатные лимиты быстро заканчиваются.

Speechnotes

Бесплатный онлайн-инструмент для быстрой транскрибации. Простой интерфейс — загрузил файл, получил текст. Подходит для разовых задач. Минус: ограниченная точность на русском языке, нет диаризации, нет API для автоматизации.

AssemblyAI

Мощное API с продвинутой диаризацией, определением тональности и автоматическим суммированием. Один из лидеров по точности на англоязычном аудио. Минус: платный сервис, основная оптимизация под английский язык. Русский поддерживается, но результаты хуже, чем у специализированных российских решений.

Сравнительная таблица

| Сервис | Русский язык | Диаризация | Бесплатно | Формат | Цена (платно) |

|---|---|---|---|---|---|

| Whisper (OpenAI) | Хорошо | Нет (нужны доп. инструменты) | Да (локально) | Локально / API | $0,006/мин (API) |

| SaluteSpeech | Отлично | Да | Пробный период | Облако (РФ) | По запросу |

| Teamlogs | Хорошо | Да | 15 мин бесплатно | Веб | От 490 руб/мес |

| BotHub | Хорошо | Нет | Лимит кредитов | Веб / Telegram | От $5/мес |

| Speechnotes | Средне | Нет | Да | Веб | — |

| AssemblyAI | Средне | Да | Пробный период | API | $0,37/час |

Совет: Если вам нужна бесплатная транскрибация для личных задач — начните с Whisper локально (при наличии видеокарты) или Speechnotes онлайн. Для регулярной работы с русским языком лучше SaluteSpeech или Teamlogs. Для интеграции в бизнес-процессы через API — Whisper API или AssemblyAI.

Как выбрать нейросеть для транскрибации — 6 критериев

Универсального решения не существует. Выбор зависит от задачи, объема и бюджета. Вот шесть критериев, которые помогут определиться.

1. Точность распознавания русского языка. Большинство моделей оптимизированы под английский. На русском результаты могут быть хуже на 5-15%. Для деловых переговоров WER должен быть ниже 10% — иначе каждое десятое слово будет с ошибкой, и текст станет нечитаемым.

2. Диаризация — разделение по спикерам. Если расшифровываете монолог (лекцию, подкаст с одним ведущим) — диаризация не нужна. Если это диалог (совещание, звонок, интервью) — без нее текст превратится в кашу из реплик без указания, кто что сказал.

3. Автоматическая пунктуация и форматирование. Текст без запятых и точек — это стенограмма, а не документ. Хорошие сервисы расставляют пунктуацию, разбивают текст на абзацы и выделяют ключевые моменты.

4. Скорость обработки. Для разовых задач скорость не критична. Для бизнеса, который обрабатывает десятки файлов ежедневно, важна пакетная обработка и время отклика. Real-time транскрибация нужна для прямых трансляций и совещаний.

5. Безопасность данных. Конфиденциальные записи (медицинские, юридические, финансовые) нельзя загружать в публичные облака. Варианты: локальная установка (Whisper), облако с серверами в РФ (SaluteSpeech) или on-premise решения.

6. Стоимость при регулярном использовании. Бесплатные 15 минут — это маркетинг. Считайте стоимость при реальном объеме. Если обрабатываете 100+ часов аудио в текст ежемесячно, разница в $0,01 за минуту — это $60 в месяц.

Частая ошибка: Выбирать сервис только по точности на демо-записях. Производители тестируют на чистом студийном аудио, а вы будете загружать записи совещаний с эхом или телефонные звонки с шумом улицы. Обязательно тестируйте на своих реальных файлах.

Как улучшить качество транскрибации — практические советы

Даже лучшая нейросеть выдаст плохой результат на плохой записи. Качество входного аудио — главный фактор точности. По данным TranscribeTube (2025), при увеличении шума на 10 дБ точность падает на 8-12%.

Вот что реально влияет на результат:

- Используйте внешний микрофон вместо встроенного в ноутбук. Даже недорогой петличный микрофон за 1500 рублей кардинально улучшит качество записи

- Записывайте в тихом помещении. Фоновый шум — враг номер один. Закройте окна, выключите кондиционер, предупредите коллег

- Для диалогов используйте многоканальную запись — каждый спикер в отдельном аудиоканале. Это значительно улучшает диаризацию

- Выбирайте правильную модель: large-v3 для максимальной точности (длинные записи, сложный контент), base или small для скорости (короткие заметки, черновые расшифровки)

- Проверяйте результат: имена собственные, аббревиатуры, специфические термины — слабое место любой нейросети. Пост-обработка занимает 10-15 минут, но спасает от критических ошибок

Совет: Если записываете телефонные звонки для бизнеса, настройте многоканальную запись в телефонии — менеджер в одном канале, клиент в другом. Такие файлы разделяются по спикерам значительно лучше, чем моно-записи.

Транскрибация для бизнеса — от расшифровки к аналитике

Все сервисы из обзора выше отлично справляются с личными задачами: расшифровать лекцию, сделать субтитры, превратить подкаст в статью. Но когда речь заходит о бизнесе — о десятках и сотнях звонков ежедневно — простой транскрибации оказывается недостаточно.

Представьте отдел продаж из 10 менеджеров. Каждый делает 30-50 звонков в день. Это 300-500 звонков. РОП физически не может прослушать их все — 50 звонков по 10 минут = 8 часов чистого прослушивания. Транскрибация ускоряет процесс: читать быстрее, чем слушать. Но читать 500 расшифровок — тоже задача на весь день.

Проблема глубже. Даже получив идеальный текст каждого звонка, бизнесу нужны не тексты, а ответы. Выявил ли менеджер потребность клиента? Отработал ли возражение «дорого»? Назвал ли цену? Договорился ли о следующем шаге — встрече, отправке КП, повторном звонке? Сам по себе текст этих ответов не дает.

Добавьте специфику телефонных звонков. WER на чистом аудио — 2,7%. WER на записях колл-центров — 17,7% (по данным AssemblyAI, 2025). Сжатие кодеков, низкий битрейт, фоновые шумы, наложение голосов — все это в 6 раз снижает точность стандартных моделей. Для звонков нужны специализированные решения.

Специализированные платформы речевой аналитики идут дальше транскрибации. Например, Rechka расшифровывает звонки за 3-5 минут, автоматически разделяет реплики менеджера и клиента, а затем проверяет разговор по настраиваемым параметрам: поздоровался ли менеджер, выявил ли потребность, отработал ли возражения, договорился ли о следующем шаге. РОП получает готовый анализ 100% звонков вместо выборочного прослушивания. Результаты автоматически подтягиваются в CRM (AmoCRM, Bitrix24), а дашборды показывают динамику по каждому менеджеру.

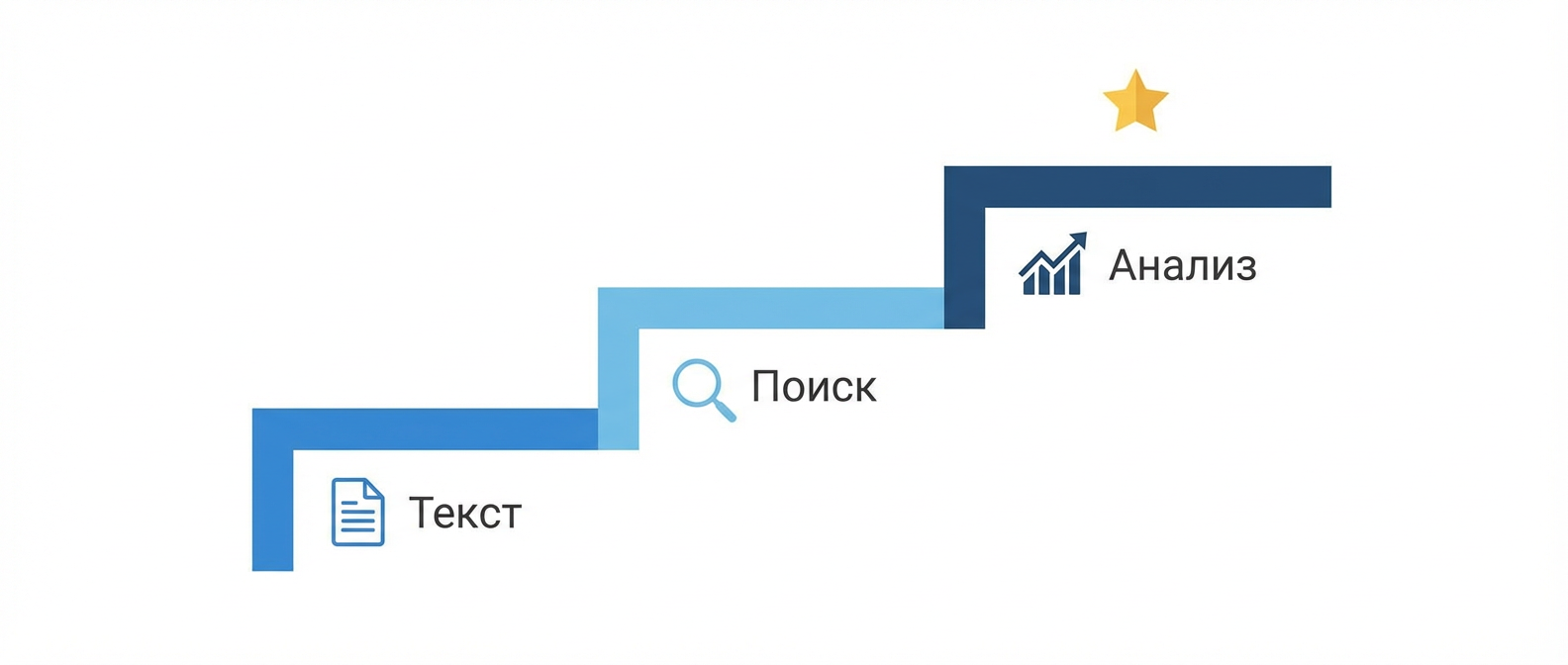

Что делать после транскрибации — 3 уровня ценности

Ценность транскрипта зависит от того, что вы с ним делаете. Можно выделить три уровня.

Уровень 1: Просто текст. Подходит контент-мейкерам. Расшифровали подкаст — получили черновик статьи. Расшифровали лекцию — получили конспект. Задача решена: аудио превратилось в текст.

Уровень 2: Текст + поиск. Подходит исследователям, аналитикам, юристам. Нужно найти конкретную цитату в часовом интервью? Поиск по тексту за секунды. Нужно проверить, что именно сказал клиент на совещании? Ctrl+F вместо перемотки записи.

Уровень 3: Текст + анализ + решения. Для бизнеса. Транскрипт становится основой для принятия решений. Rechka не просто расшифровывает звонки, а автоматически определяет, какие возражения менеджеры не отрабатывают, где теряются клиенты и кого из сотрудников нужно обучить в первую очередь. Функция суммаризации позволяет задавать ИИ вопросы по массиву из сотен звонков и получать сводную аналитику: топ возражений, причины отказов, план обучения. Транскрибация здесь — фундамент, но не конечная цель.

Если ваша задача — не просто расшифровать звонки, а понять, где менеджеры теряют клиентов, стоит попробовать специализированный инструмент.

Загрузите 30 минут записей — ИИ не просто расшифрует, а проанализирует каждый звонок: ошибки менеджеров, упущенные сделки, точки роста. Результат за 24 часа.

Получить анализ бесплатно ->Но даже если вы выбрали инструмент для анализа, качество исходной транскрибации остается важным. Разберем вопросы, которые чаще всего возникают при работе с нейросетями для расшифровки.

Мнение эксперта

Часто задаваемые вопросы

ИИ расшифрует и проанализирует 30 минут ваших звонков — покажет ошибки менеджеров, потерянных клиентов и точки роста конверсии

Получить бесплатный анализ -> Бесплатно . Результат за 24 часа . Без обязательствВыводы

Нейросети сделали транскрибацию быстрой, точной и доступной. Whisper, SaluteSpeech, Teamlogs и другие сервисы закрывают большинство задач по расшифровке аудио — от личных записей до корпоративных совещаний.

Выбор сервиса зависит от задачи. Для личного использования подойдут бесплатные решения (Whisper локально, Speechnotes). Для регулярной работы с русским языком — SaluteSpeech или Teamlogs. Для интеграции через API — Whisper API или AssemblyAI.

Но транскрибация — это только первый шаг. Если вам нужно не просто получить текст из аудио, а проанализировать звонки отдела продаж и найти точки роста конверсии, попробуйте Rechka бесплатно: 30 минут анализа в подарок, результат за 24 часа.